Introducción

Antes del descubrimiento de Australia, en el Viejo Mundo se creía que todos los cisnes eran blancos. Parecía una creencia irrefutable. Pero, entonces, se vio que en Australia los cisnes también podían ser negros.

Este hecho ilustra una grave limitación del aprendizaje que se hace desde la observación o la experiencia, así como la fragilidad de nuestro conocimiento. Una sola observación es capaz de invalidar una afirmación generalizada. Todo lo que se necesita es una sola ave negra.

El Cisne Negro es un suceso que se caracteriza por los siguientes atributos:

- Es una rareza, porque está fuera de las expectativas normales;

- produce un impacto tremendo;

- pese a su condición de rareza, la naturaleza humana hace que inventemos explicaciones de su existencia después del hecho, con lo que, erróneamente, se hace explicable y predecible.

Una pequeña cantidad de Cisnes Negros está en el origen de casi todo lo concerniente a nuestro mundo, desde el éxito de las ideas y las religiones, hasta la dinámica de los acontecimientos históricos y los elementos de nuestra propia vida personal.

Sucesos como el ascenso de Hitler y la posterior Guerra Mundial, la desaparición del bloque soviético, la aparición del fundamentalismo islámico, los efectos de la difusión de internet, las crisis económicas, las epidemias, la moda, las ideas... todos siguen la dinámica del Cisne Negro. La incapacidad de predecir las rarezas implica la incapacidad de predecir el curso de la historia, dada la incidencia de estos sucesos en la dinámica de los acontecimientos.

Y es que la historia es opaca. Se ve lo que aparece, no el guion que produce los sucesos, el generador de la historia. Nuestra forma de captar estos sucesos es en buena medida incompleta, ya que no vemos qué hay dentro de la caja, cómo funcionan los mecanismos.

Lo anterior se debe al error de la confirmación: pensamos que el mundo en que vivimos es más comprensible, más explicable y, por consiguiente, más predecible de lo que en realidad es. Nos centramos en segmentos preseleccionados de lo visto y, a partir de ahí, generalizamos en lo no visto.

Nuestra mente es una magnífica máquina de explicación, capaz de dar sentido a casi todo, hábil para ensartar explicaciones para todo tipo de fenómenos, y generalmente incapaz de aceptar la idea de la impredecibilidad. El análisis aplicado y minucioso del pasado no nos dice gran cosa sobre el espíritu de la historia; solo nos crea la ilusión de que la comprendemos. Se diría que las personas que vivieron los inicios de la Segunda Guerra Mundial tuvieron el presentimiento de que se estaba produciendo algo de capital importancia. En absoluto.

Los sucesos se nos presentan de forma distorsionada. Pensemos en la naturaleza de la información: de los millones de pequeños hechos que acaecen antes de que se produzca un suceso, resulta que solo algunos serán después relevantes para nuestra comprensión de lo sucedido. Dado que nuestra memoria es limitada y está filtrada, tenderemos a recordar aquellos datos que posteriormente coincidan con los hechos.

No obstante, actuamos como si fuéramos capaces de predecir los hechos o cambiar el curso de la historia. Hacemos proyecciones a treinta años vista del déficit de la seguridad social y de los precios del petróleo, sin darnos cuenta de que no podemos prever unos y otros ni siquiera de aquí al verano que viene. Sin embargo, lo sorprendente no es la magnitud de nuestros errores de predicción, sino la falta de conciencia que tenemos de ellos.

Nuestra incapacidad para predecir en entornos sometidos al Cisne Negro, unida a una falta general de conciencia de este estado de las cosas, significa que determinados profesionales, aunque creen que son expertos, de hecho no lo son. Resulta que no saben sobre la materia de su oficio más que la población en general, solo que saben contarlo mejor y aturdirnos con sus complejos modelos matemáticos.

Es fácil darse cuenta también de que la vida es el efecto acumulativo de un puñado de impactos importantes. Hagamos el siguiente ejercicio. Pensemos en nuestra propia existencia. Contemos los sucesos importantes, los cambios tecnológicos y los inventos que han tenido lugar en nuestro entorno desde que nacimos, y comparémoslos con lo que se esperaba antes de su aparición. ¿Cuántos se produjeron siguiendo un programa? Fijémonos en nuestra propia vida, en la elección de una profesión, por ejemplo, o en cuando conocimos a nuestra pareja, o en el enriquecimiento o el empobrecimiento súbitos. ¿Con qué frecuencia ocurrió todo esto según un plan preestablecido…?

La lógica del Cisne Negro hace que lo que no sabemos sea más importante que lo que sabemos. Tengamos en cuenta que muchos Cisnes Negros pueden estar causados y exacerbados por el hecho de ser inesperados.

Dado que los Cisnes Negros son impredecibles, tenemos que amoldarnos a su existencia. Hay muchas cosas que podemos hacer si nos centramos en lo que no sabemos. Podemos dedicarnos a buscar Cisnes Negros positivos con el método de la serendipia, llevando al máximo nuestra exposición a ellos. En algunos ámbitos (descubrimientos científicos, inversiones de capital), lo desconocido puede ofrecer una compensación desproporcionada, ya que se suele perder poco y ganar mucho de un suceso raro. Contrariamente a lo que se piensa en el ámbito de la ciencia social, casi ningún descubrimiento ni ninguna tecnología destacable surgieron del diseño y la planificación, sino que fueron Cisnes Negros. La estrategia de los descubridores y emprendedores es confiar menos en la planificación, centrarse al máximo en reconocer las oportunidades cuando se presentan y juguetear con ellas.

De Mediocristán a Extremistán

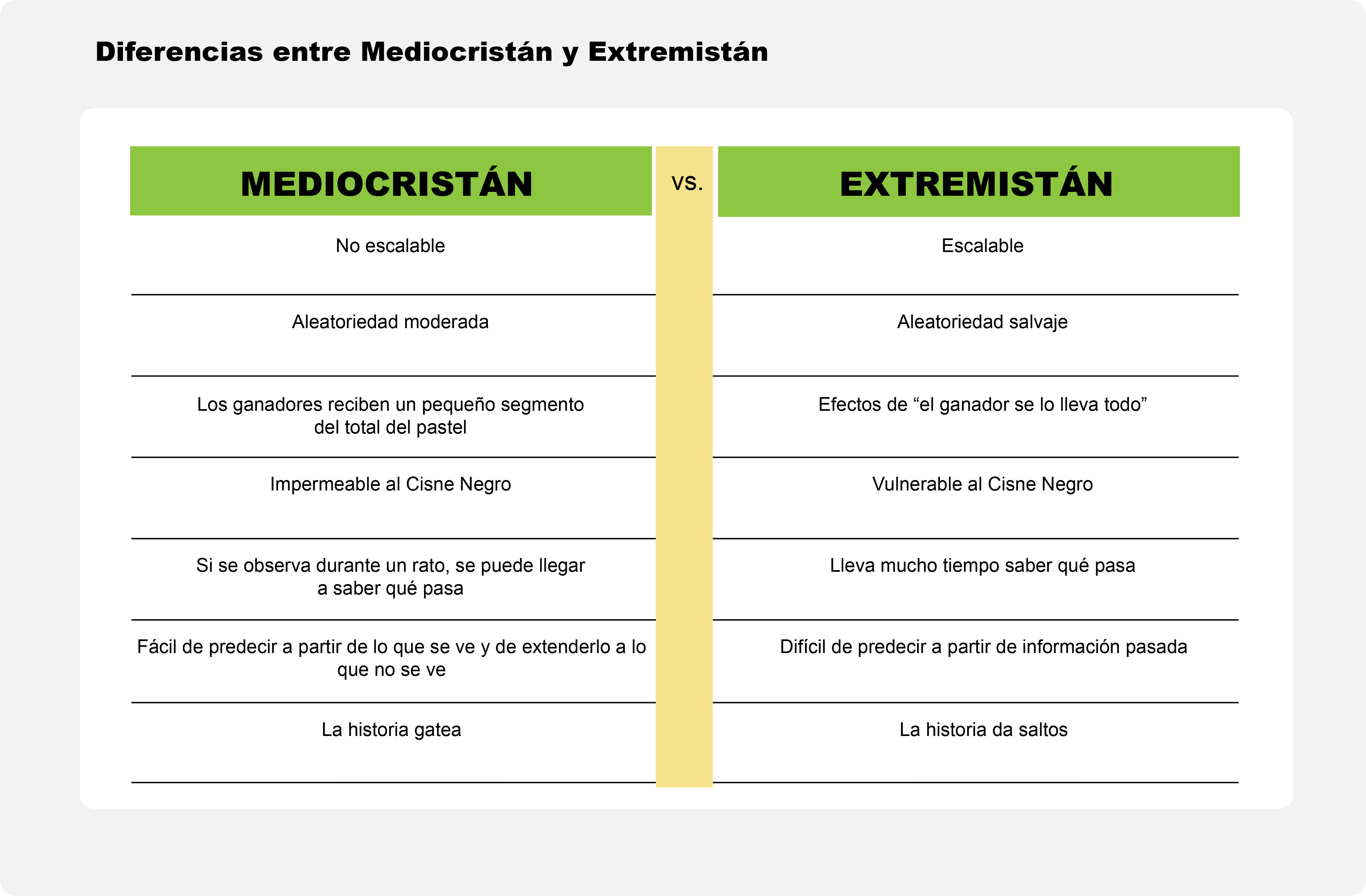

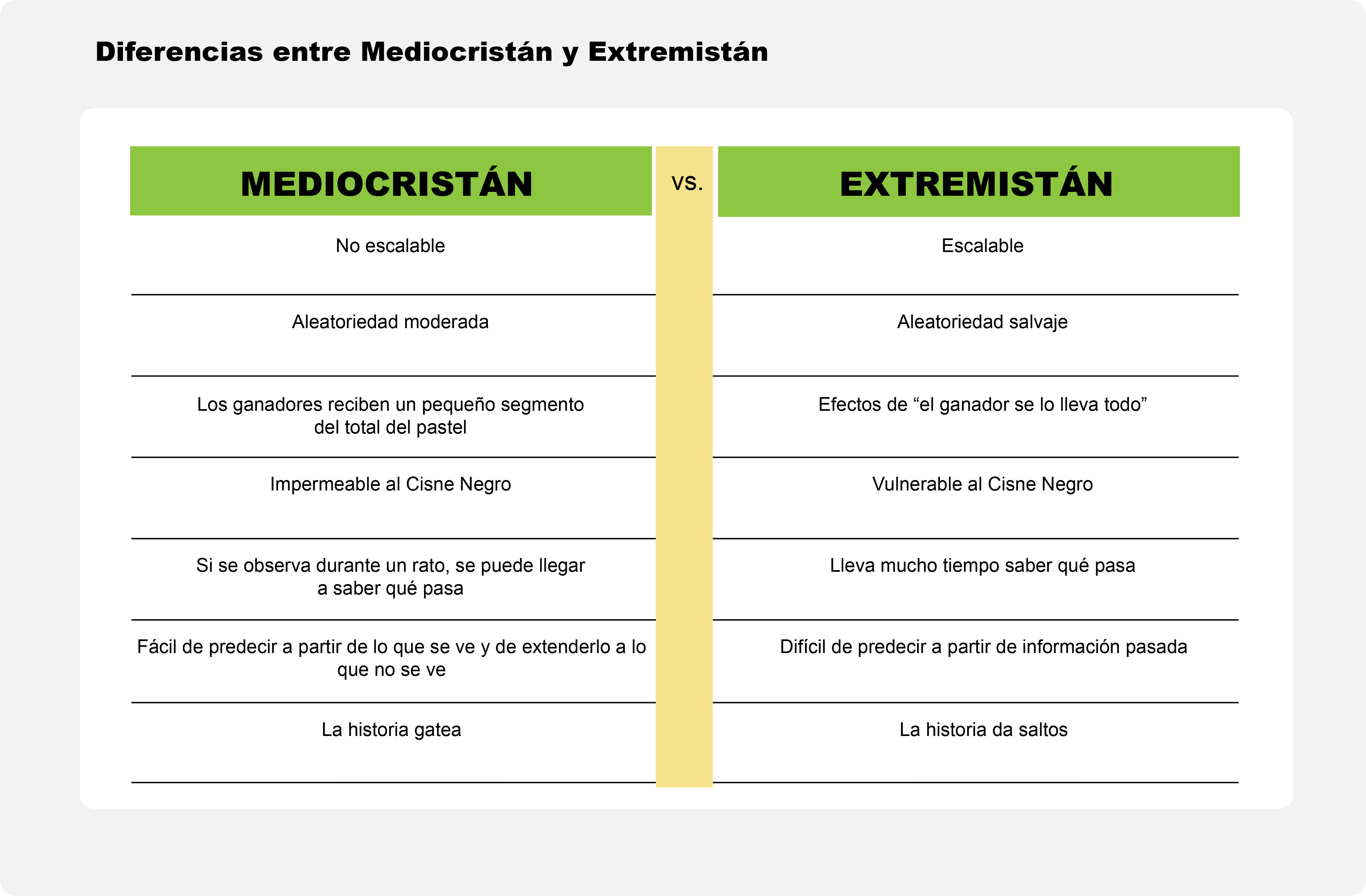

Existen dos tipos de incertidumbre o dos variantes del azar. El primero lo podríamos llamar la provincia utópica de Mediocristán, donde los sucesos individuales no aportan mucho individualmente, sino solo de forma colectiva. La regla suprema de Mediocristán se puede formular en estos términos: “Cuando la muestra es grande, ningún elemento singular cambiará de forma significativa el total”. Para ilustrarlo, tomemos el ejemplo de nuestro consumo de calorías. Los humanos consumimos cerca de ochocientas mil calorías al año. Ningún día concreto supondrá una gran parte de esa cantidad.

Consideremos por comparación el valor neto de las mil personas que seleccionemos aleatoriamente a la salida de un estadio de fútbol. Añadámosles la persona más rica del planeta, por ejemplo Bill Gates. Supongamos que su patrimonio sea de unos 80 000 millones de dólares, siendo el capital de todos los demás unos cuantos millones. Dicho patrimonio representará el 99,9 % de la riqueza total. Esa es la segunda variante del azar: Extremistán, donde “las desigualdades son tales que una única observación puede influir de forma desproporcionada en el total”.

Fijémonos en las implicaciones que esto tiene. Extremistán puede producir Cisnes Negros, y de hecho lo hace, como en el caso de sucesos raros que han influido colosalmente en la historia. Pero con el azar al estilo de Mediocristán no es posible encontrarse con la sorpresa de un Cisne Negro, la sorpresa de que un único suceso pueda dominar un fenómeno.

Lo que en Mediocristán se puede saber a partir de los datos aumenta con mucha rapidez a medida que se acumula información. Sin embargo, en Extremistán el conocimiento crece muy despacio y de forma errática con la acumulación de datos —algunos de ellos extremos—, posiblemente a un ritmo desconocido.

Agustín Rezk

Excelente libro sobre como somos muy malos para hacer predicciones ?? para leer varias veces. Gracias!

Holder Bookers Club

Deja otra perspectiva acerca del futuro y de como los seres humanos nos afrontamos a él, también útil para el tema de inversiones y otros modelos de negocios que jueguen con la probabilidad

Fernando Mazariego Rodriguez

Aquí aprendes a aceptar que no puedes predecir el futuro, es una falacia.